OpenAI 在 2026 年 5 月 7 日发布了 Scaling Trusted Access for Cyber with GPT-5.5 and GPT-5.5-Cyber。这条新闻表面上看很窄,像是专门给网络安全团队看的能力更新,所以很多站点会直接跳过。但它其实很值得普通企业团队、自动化负责人和 AI 选型人关注,因为它把一个更重要的问题摆到了台前:当 AI 要进入高风险研究流程时,企业真正该评估的到底是什么。

对本站用户来说,这不是一条“马上去买某个模型”的消费型新闻,而是一条“企业如何判断 AI 能不能进入敏感流程”的判断型新闻。它服务的是企业落地和工作流设计,而不是单一模型追新。

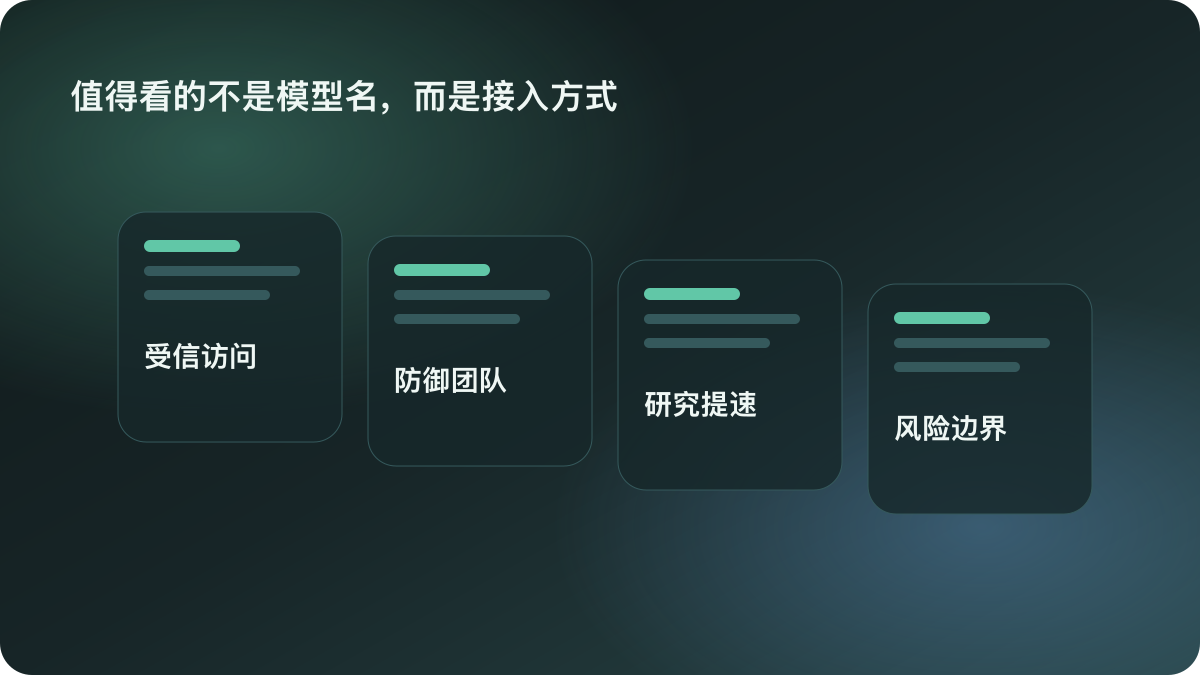

这次更新值得看的不是模型名,而是接入方式

如果只盯着 GPT-5.5 或 GPT-5.5-Cyber 这些名字,容易把这篇官方文章读成普通型号升级。真正该看的是 Trusted Access for Cyber 这个接入框架。OpenAI 在官方页面里强调的是:把更强的模型能力放进一个受控、面向防御研究者的访问路径里,而不是简单把能力对所有人无限放开。

这说明企业 AI 的一个重要现实没有变:高风险场景里,能力本身从来不是唯一门槛。组织更在意的是谁能访问、基于什么目的访问、用在什么范围、是否有监督与边界,以及出问题后能不能复盘。

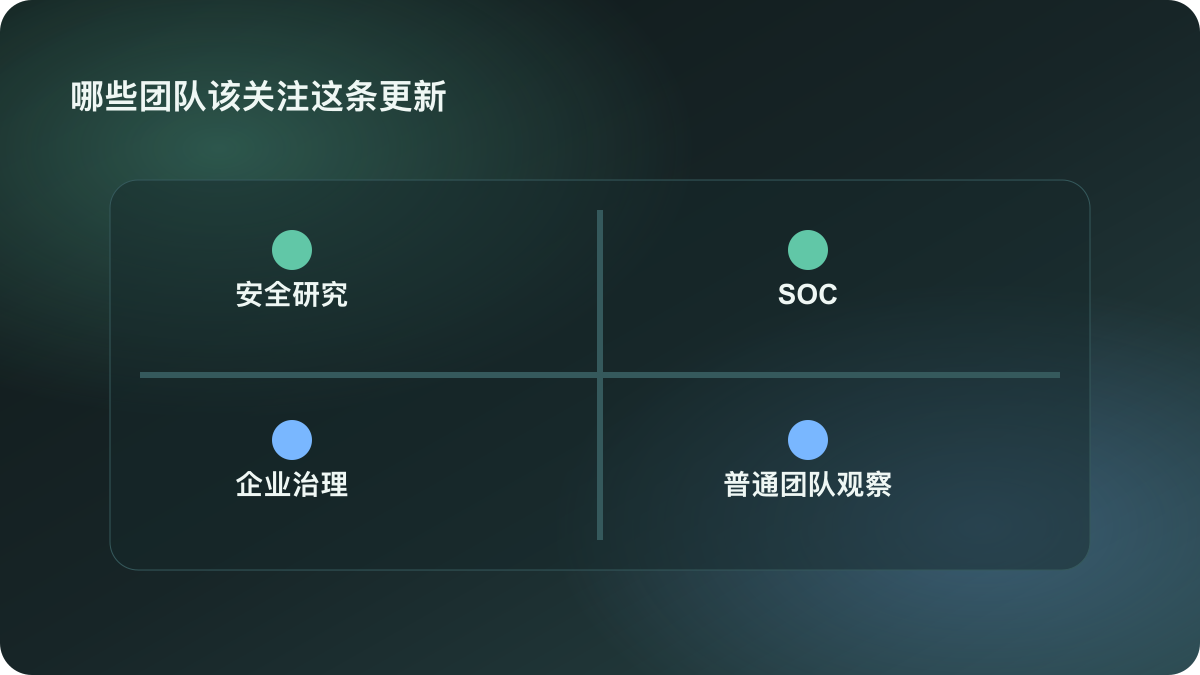

这套判断逻辑并不只属于网络安全团队。任何把 AI 放进敏感流程的组织,都会遇到类似问题。只是安全研究把这些问题放大得更早、更清楚。

为什么普通团队也该看这条新闻

很多普通团队会觉得,“我们又不做漏洞研究,这条新闻和我们无关。”其实恰恰相反。它和普通团队的关系,不在于你要不要用 GPT-5.5-Cyber,而在于它给了一个更成熟的企业判断框架。

过去很多企业做 AI 试点时,只问三件事:

- 模型够不够强

- 成本高不高

- 集成难不难

现在这三件事已经不够了。像 Trusted Access for Cyber 这样的发布,会迫使企业补上第四类问题:

- 能力是不是放在受控入口里

- 谁能用,谁不能用

- 适用边界是不是明确

- 失败结果有没有人工接手点

如果一支团队在高风险研究场景里都开始按这种方式评估 AI,那么普通企业在合同、财务、客服、法务、运营和内部知识流程里,也迟早要补上类似门槛。区别只是风险高低不同,不是逻辑不同。

和 ChatGPT、Claude、Make 这类工具的关系

这条新闻不意味着 ChatGPT 或 Claude 应该直接进每个敏感流程。更准确的理解是:OpenAI 正在示范一种企业接入方式,普通团队可以把这种思路往自己熟悉的工具上迁移。

例如,很多团队已经会用 ChatGPT 做研究草稿、总结内部文档或分析初步样本,也会用 Make 这类工具把 AI 步骤接进审批、通知和字段流转。如果今天还只是“哪个模型更会回答”,这个工作流是不完整的。真正可落地的版本应该补上边界:

- 哪些步骤只允许做建议,不允许自动执行

- 哪些输出必须进入人工复核

- 哪些失败样本要被记录下来

- 哪些领域只允许在特定团队或特定账号下试点

这就是为什么这篇文章把 relatedTools 放在 chatgpt、claude 和 make。它不只是讲模型,也讲组织如何把模型能力接进流程。

企业现在最该跟进的动作

如果你是企业里的 AI 项目负责人,这条新闻可以直接转成一个内部检查问题:我们目前的 AI 项目里,有没有哪些流程其实已经接近“高风险研究”或“高敏感判断”,但我们还在用普通工具试用心态对待它?

最常见的误区有三种:

- 把高风险流程也当成普通问答使用,没有分层入口。

- 让 AI 输出直接进入执行链路,没有人工复核。

- 只盯模型效果,不记录失败模式和适用边界。

更稳的做法,是先给流程分级。低风险流程继续用普通助手做摘要、草稿和分类;中风险流程加入审批、日志和回看;高风险流程则必须限制访问入口、明确责任人,并先从只读或建议模式开始。

为什么今天发这一篇,而不是硬凑第三条新模型新闻

它来自 OpenAI 官方,发布日期清晰,而且比泛泛的模型榜单更能服务本站用户的企业落地判断。今天真正有价值的热点,不一定是“又一个新模型”,而是“企业开始如何重新定义 AI 的接入边界”。这篇正好属于后一类。

它也提醒我们,企业 AI 竞争正在继续从“谁最强”转向“谁能被放进真实流程”。这个标准一旦形成,普通团队以后做 AI 自动化,不会只比模型回答,而会更认真地比接入方式、审批点和失败恢复能力。

参考来源:

- OpenAI: Scaling Trusted Access for Cyber with GPT-5.5 and GPT-5.5-Cyber